L'intelligence artificielle embarquée, désignée sous le terme Edge AI, représente l'un des changements les plus significatifs dans le déploiement de l'IA en 2026 : plutôt que d'envoyer des données vers des serveurs cloud distants pour les traiter, les modèles s'exécutent directement sur les appareils à la périphérie du réseau — caméras industrielles, capteurs IoT, terminaux mobiles, équipements de production. Pour les PME françaises, cette évolution ouvre des cas d'usage concrets auparavant réservés aux grandes entreprises disposant d'infrastructures cloud coûteuses.

Edge AI : définition et distinction avec le cloud computing

L'Edge AI désigne l'exécution de modèles d'intelligence artificielle directement sur des dispositifs locaux, sans dépendance à une connexion internet pour chaque inférence. La distinction avec l'IA cloud traditionnelle est fondamentale : dans un système cloud, les données — images, sons, capteurs — sont envoyées vers un serveur distant qui effectue l'analyse et renvoie le résultat. Dans un système Edge AI, l'analyse s'effectue localement, en quelques millisecondes, sur le dispositif lui-même ou sur un serveur de périphérie proche.

Cette architecture locale offre trois avantages décisifs pour les PME. La latence est réduite à quelques millisecondes contre plusieurs centaines de millisecondes en cloud — critique pour les applications industrielles en temps réel comme la détection de défauts sur une ligne de production. La confidentialité des données est préservée puisque les informations sensibles ne quittent pas le périmètre de l'entreprise, ce qui simplifie la conformité RGPD pour les PME traitant des données personnelles ou propriétaires. Enfin, le fonctionnement hors ligne est possible, ce qui est essentiel pour les environnements industriels avec connectivité limitée ou pour les applications critiques qui ne peuvent pas tolérer d'interruption de service cloud.

Pour compléter cette vue d'ensemble, l'article sur les Small Language Models (SLM) et Edge AI en entreprise explore en détail comment les modèles de langage compacts s'intègrent dans les architectures de périphérie pour des applications métier accessibles aux PME sans infrastructure cloud lourde.

Les cas d'usage concrets de l'IA embarquée en PME

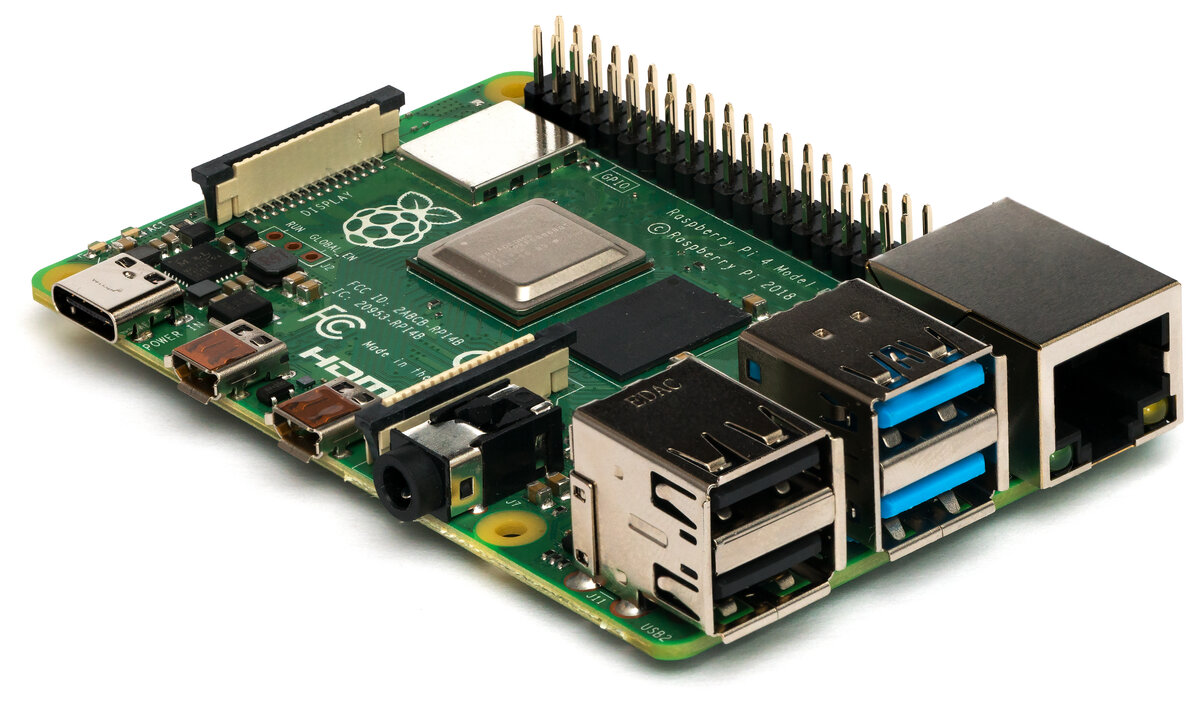

L'Edge AI n'est plus réservée aux grandes industries. Les composants matériels — microcontrôleurs spécialisés, SoC (System on Chip) avec accélérateur neuronal, cartes de développement comme le Raspberry Pi ou le NVIDIA Jetson — ont chuté en prix au point qu'une PME peut déployer un système d'IA embarquée pour quelques centaines d'euros de matériel.

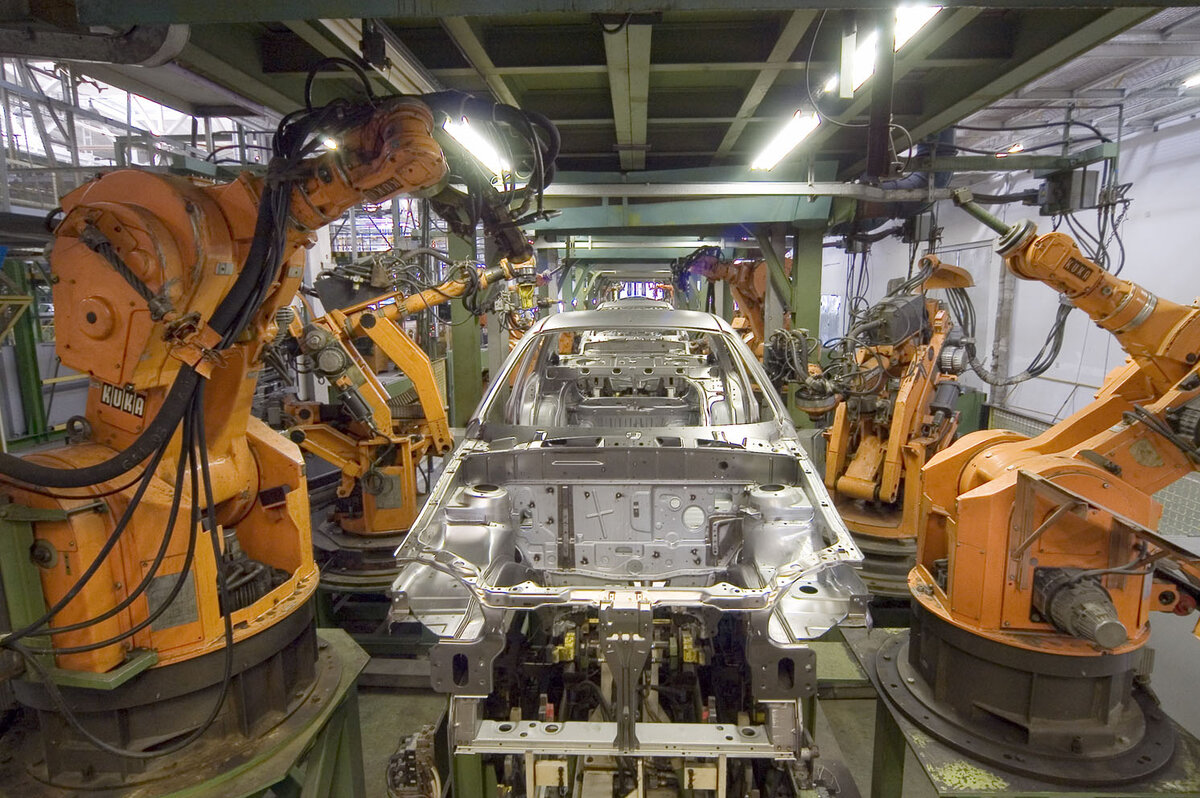

Dans l'industrie manufacturière, la détection de défauts visuels par caméra industrielle équipée d'un modèle de vision par ordinateur représente l'application phare de l'Edge AI en PME. Un système qui analyse 30 pièces par seconde en temps réel et signale les anomalies avec une précision supérieure à 99 % remplace avantageusement une inspection humaine fatigable et coûteuse. Le déploiement de ces systèmes est facilité par des plateformes spécialisées : Edge Impulse permet par exemple de former et déployer des modèles de vision et d'analyse de capteurs sans expertise en deep learning avancée.

Dans le commerce et la distribution, des caméras Edge AI analysent les flux de clients dans les rayons pour optimiser le placement des produits et la gestion des files d'attente, sans transmettre d'images vers un cloud — ce qui résout la question de la conformité RGPD pour le traitement d'images en espaces publics. Dans la restauration et l'hôtellerie, des systèmes Edge AI surveillent la température des équipements de froid et prédisent les pannes avant qu'elles n'entraînent des pertes de marchandises. Des prestataires spécialisés accompagnent les PME dans l'évaluation et le déploiement de ces solutions Edge AI sans reconstruire leur infrastructure informatique.

Infrastructure Edge AI : matériel, modèles et déploiement

Déployer une solution Edge AI en PME nécessite de comprendre les composants de la chaîne technique, même sans être expert en intelligence artificielle. Trois couches constituent le système : le matériel de périphérie, les modèles d'IA optimisés pour la contrainte de ressources, et les outils de gestion du cycle de vie des modèles.

Au niveau matériel, les options s'échelonnent selon les besoins de performance et de budget. Les microcontrôleurs avec accélérateur neuronal (comme la gamme STM32 de STMicroelectronics ou les ESP32-S3 d'Espressif) permettent des inférences simples pour moins de 5 euros par unité, adaptés aux capteurs et aux applications IoT légères. Les SBC (Single Board Computers) comme le Raspberry Pi 4 ou le NVIDIA Jetson Nano offrent plus de puissance de calcul pour les applications de vision par ordinateur et coûtent entre 50 et 300 euros. Les serveurs de périphérie dédiés (edge servers) s'adressent aux applications industrielles critiques nécessitant un traitement haute fréquence et une fiabilité maximale.

Au niveau logiciel, les frameworks TensorFlow Lite, ONNX Runtime et PyTorch Mobile permettent de déployer des modèles entraînés en cloud sur du matériel contraint en mémoire et en puissance de calcul. La quantification des modèles — réduction de la précision arithmétique de 32 bits à 8 bits — réduit typiquement la taille d'un modèle de 75 % et son temps d'inférence de 2 à 4 fois, avec une perte de précision généralement inférieure à 2 %. Ces optimisations rendent accessibles des modèles complexes sur du matériel accessible. Notre service d'intégration IA dans les systèmes existants accompagne les PME depuis le choix du matériel jusqu'à la mise en production des modèles Edge.

Edge AI et réglementation : AI Act et données souveraines

L'entrée en vigueur de l'AI Act européen en 2024-2026 introduit des obligations de conformité pour les systèmes d'IA déployés dans certains secteurs à risque. Pour les PME, comprendre comment l'Edge AI s'inscrit dans ce cadre réglementaire est essentiel pour déployer sans risque juridique.

L'AI Act classe les systèmes d'IA selon leur niveau de risque : interdit, à haut risque, à risque limité, et à risque minimal. Pour la plupart des applications Edge AI en PME — détection de défauts industriels, optimisation de processus, analyse de flux internes — le niveau de risque est minimal ou limité, ce qui implique des obligations légères : transparence sur l'utilisation de l'IA dans le contexte concerné, et tenue d'une documentation technique basique. Les applications à haut risque comme la reconnaissance faciale dans des espaces publics ou les systèmes d'évaluation des personnes sont soumises à des exigences beaucoup plus strictes et nécessitent un accompagnement juridique spécifique.

Sur le volet de la souveraineté des données, l'Edge AI offre un avantage structurel par rapport aux solutions cloud : les données traitées localement ne transitent pas par des serveurs de fournisseurs cloud étrangers, ce qui simplifie la conformité au RGPD et répond aux exigences de certains secteurs sensibles comme la défense, la santé ou les infrastructures critiques qui doivent garantir que leurs données restent sur le territoire national.

FAQ — Edge AI pour les PME françaises en 2026

- Quel budget prévoir pour un premier projet Edge AI en PME ?

- Un projet pilote d'Edge AI — détection de défauts par caméra ou analyse de capteurs — peut être démarré avec un budget matériel de 500 à 2 000 euros et un investissement en développement de 5 000 à 20 000 euros selon la complexité. Des solutions SaaS d'Edge AI comme Edge Impulse ou Azure Percept réduisent le coût de développement en fournissant des outils de formation de modèles sans expertise en deep learning avancée.

- Faut-il des compétences en IA pour déployer une solution Edge AI ?

- Non, les plateformes modernes d'Edge AI ont rendu ce déploiement accessible sans expertise en machine learning. Des outils no-code ou low-code permettent de former des modèles de classification visuelle à partir d'exemples photographiés avec un smartphone en quelques heures. Pour des applications plus complexes, un prestataire spécialisé peut réaliser le développement en quelques semaines et former un référent interne à la maintenance courante du système.

- Quelle est la différence entre Edge AI et IoT ?

- L'IoT (Internet des Objets) désigne la connectivité des appareils physiques au réseau, tandis que l'Edge AI désigne l'exécution locale de modèles d'intelligence artificielle sur ces appareils ou près d'eux. L'Edge AI est souvent déployée sur des appareils IoT pour leur donner des capacités d'analyse autonome, mais elle peut aussi fonctionner sur des équipements non connectés à internet, comme une caméra industrielle en réseau local fermé.

- Comment évaluer la pertinence d'une application Edge AI pour son entreprise ?

- Quatre critères guident l'évaluation : la fréquence et le volume des décisions à automatiser (un cas récurrent justifie l'investissement), la tolérance à la latence (une décision en temps réel exige l'Edge), les contraintes de confidentialité des données traitées, et la disponibilité de données d'entraînement suffisantes (en général au moins 500 exemples par classe pour un modèle de vision). Un atelier d'idéation d'une journée avec les équipes opérationnelles suffit généralement à identifier deux ou trois cas d'usage prioritaires.

- L'Edge AI est-elle compatible avec une architecture cloud existante ?

- Oui, l'Edge AI et le cloud computing sont complémentaires et non concurrents dans la plupart des architectures modernes. Le modèle hybride edge-cloud est le plus répandu : les inférences en temps réel s'exécutent en local pour la réactivité et la confidentialité, tandis que les données agrégées et anonymisées remontent vers le cloud pour l'entraînement de nouvelles versions des modèles et l'analyse de tendances sur longue période. Cette architecture donne le meilleur des deux mondes.

Image : © Gareth Halfacree / Wikimedia Commons, Raspberry Pi 4 Model B. CC BY-SA 2.0.