2025 fut l'année des modèles géants. 2026 pourrait être celle des modèles ciblés. Selon Harvard Business Review, les Small Language Models (SLM) redéfinissent l'IA d'entreprise en offrant des solutions plus rapides, plus efficaces et moins coûteuses que les Large Language Models. Leur conception compacte permet un déploiement sur des appareils edge, autorisant des décisions en temps réel sans dépendance au cloud.

2025 : l'année des LLM géants, 2026 : le retour des modèles ciblés

La course aux paramètres a atteint ses limites. GPT-4 et ses centaines de milliards de paramètres impressionnent par leurs capacités générales, mais leur coût d'exploitation et leur latence les rendent inadaptés à de nombreux cas d'usage professionnels.

Un appel API vers GPT-4 coûte entre 0,03 et 0,12 dollar pour 1 000 tokens. Pour une entreprise traitant des millions de requêtes quotidiennes, la facture devient vite prohibitive. Sans compter les questions de confidentialité : envoyer des données sensibles vers des serveurs externes pose des problèmes de conformité, notamment vis-à-vis du RGPD.

Les SLM apportent une réponse à ces contraintes. Avec des tailles allant de quelques centaines de millions à quelques milliards de paramètres, ils peuvent tourner sur des infrastructures locales, voire sur des appareils embarqués.

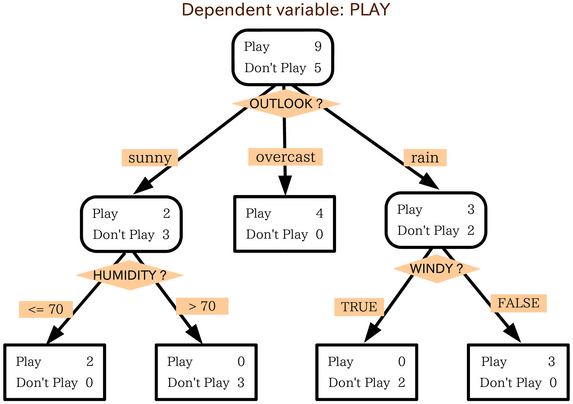

| Critère | LLM (GPT-4) | SLM (Mistral 7B) |

|---|---|---|

| Paramètres | 1 000+ milliards | 7 milliards |

| Coût API (1M tokens) | 30-60 $ | ~0,20 $ (local) |

| Latence | 500-2000 ms | 50-200 ms |

| Déploiement edge | Impossible | Possible |

| Données privées | Cloud externe | 100% local |

SLM : quand « petit » rime avec « efficace »

Le terme « petit » est relatif. Un modèle de 3 milliards de paramètres comme Ministral-3B de Mistral AI reste une prouesse technologique. Mais comparé aux 175 milliards de GPT-3 ou aux estimations dépassant le trillion pour GPT-4, il s'agit bien d'une autre catégorie.

L'efficacité des SLM repose sur plusieurs facteurs :

Spécialisation. Un modèle entraîné sur un domaine précis (juridique, médical, financier) peut surpasser un généraliste sur les tâches de ce domaine. Le fine-tuning sur des données métier permet d'atteindre des performances remarquables avec des ressources limitées.

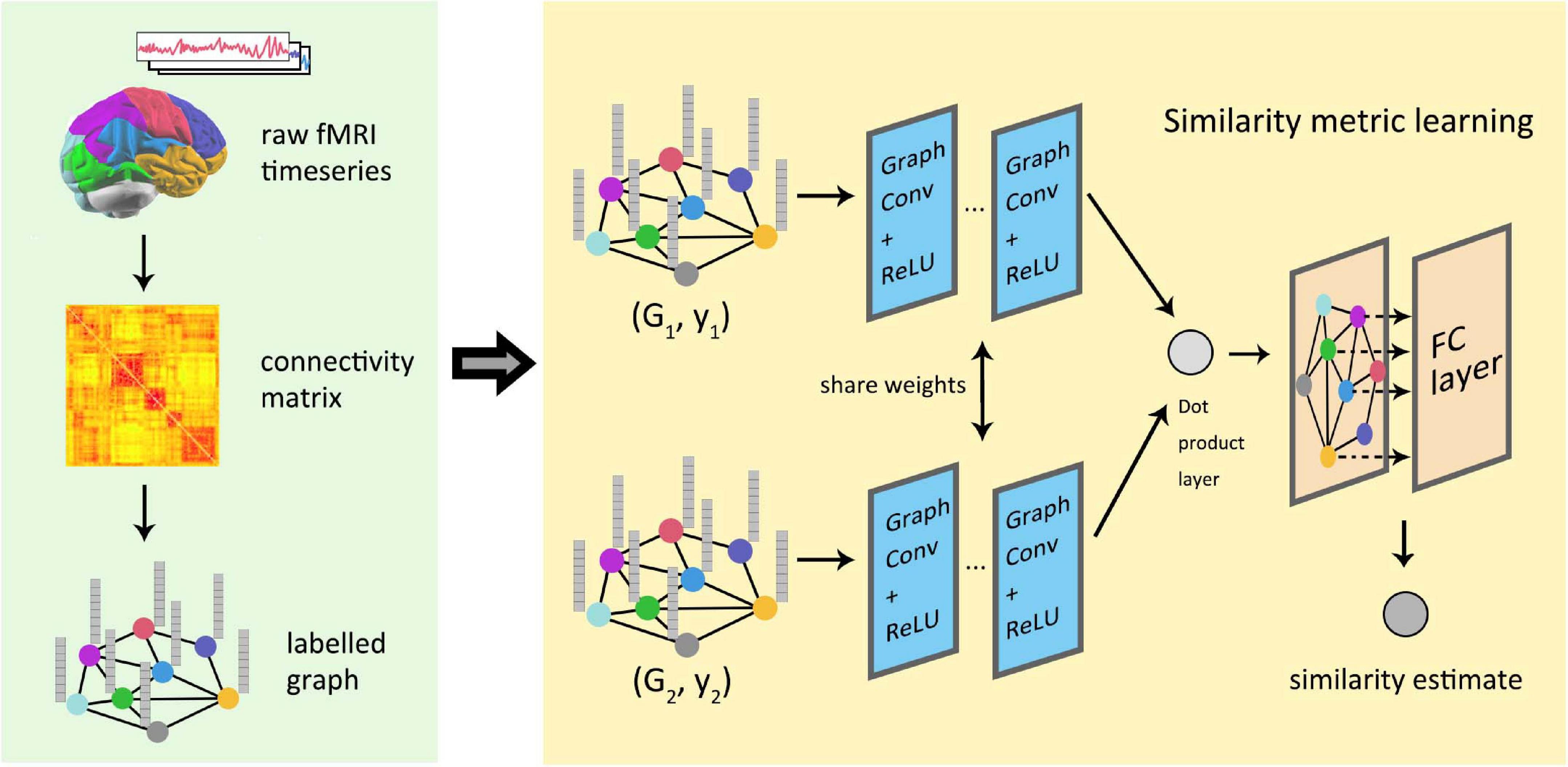

Distillation. Les techniques de distillation de connaissances permettent de transférer le « savoir » d'un grand modèle vers un plus petit, conservant l'essentiel des capacités tout en réduisant drastiquement la taille.

Quantization. La réduction de la précision des calculs (de 32 bits à 8 ou 4 bits) diminue l'empreinte mémoire sans dégrader significativement les performances.

Pour les entreprises qui souhaitent explorer ces possibilités, des prestations d'intégration d'IA dans les systèmes existants permettent d'évaluer la faisabilité technique et réglementaire.

Cinq cas d'usage concrets pour les entreprises

Santé : diagnostic médical local

Les établissements de santé manipulent des données hautement sensibles. Un SLM déployé sur site peut analyser des comptes-rendus médicaux, suggérer des diagnostics différentiels ou extraire des informations structurées, sans qu'aucune donnée patient ne quitte l'infrastructure hospitalière.

Finance : conformité réglementaire

Les banques et assurances doivent analyser des volumes considérables de documents pour vérifier leur conformité. Un SLM spécialisé peut automatiser cette tâche, identifiant les clauses problématiques ou les écarts par rapport aux normes en vigueur.

Industrie manufacturière

Sur une ligne de production, la latence compte. Un SLM embarqué dans un système de contrôle qualité peut analyser des images en temps réel, détecter des défauts et déclencher des alertes sans attendre une réponse du cloud.

Service client

Les chatbots de première ligne n'ont pas besoin de la puissance de GPT-4 pour répondre aux questions fréquentes. Un SLM bien entraîné sur la base de connaissances de l'entreprise peut gérer 80 % des requêtes à une fraction du coût.

Analyse documentaire

Résumer des contrats, extraire des clauses clés, comparer des versions : autant de tâches où un SLM spécialisé excelle, avec des temps de réponse inférieurs à la seconde.

Edge AI : l'intelligence directement dans vos appareils

L'Edge AI désigne le déploiement de modèles d'intelligence artificielle directement sur les appareils périphériques : smartphones, capteurs industriels, véhicules, robots. Les SLM rendent cette approche viable pour des applications de traitement du langage naturel.

Les avantages sont multiples : latence réduite (pas de temps de transmission vers le cloud), fonctionnement hors ligne (l'IA reste opérationnelle même sans connexion), confidentialité renforcée (les données restent sur l'appareil), et coûts maîtrisés (pas de facturation à l'usage).

Nvidia, avec sa plateforme Jetson, et Qualcomm, avec ses puces Snapdragon, proposent des solutions matérielles optimisées pour l'exécution de SLM en edge. Les frameworks comme ONNX Runtime ou TensorFlow Lite facilitent le déploiement.

Les PME françaises peuvent-elles en profiter dès maintenant ?

La réponse est oui, à condition de bien cadrer le projet. Comme nous l'avons analysé dans notre guide sur l'IA générative pour PME, la première étape consiste à identifier les cas d'usage à fort impact et faible complexité.

Plusieurs options s'offrent aux entreprises :

Utiliser des SLM open source. Mistral 7B, Llama 3.2, Phi-3 de Microsoft : ces modèles sont disponibles gratuitement et peuvent être fine-tunés sur des données métier. L'investissement se limite alors à l'infrastructure de calcul et à l'expertise interne.

Passer par des plateformes managées. Des services comme Hugging Face Inference Endpoints ou AWS SageMaker permettent de déployer des SLM sans gérer l'infrastructure. Le coût reste inférieur à celui des API des grands modèles.

Opter pour des solutions verticales. Des éditeurs spécialisés proposent des SLM pré-entraînés pour des secteurs spécifiques (juridique, RH, comptabilité). L'intégration est plus rapide, mais la personnalisation plus limitée.

Les défis à anticiper

L'adoption des SLM n'est pas sans obstacles. Le fine-tuning requiert des compétences en machine learning que toutes les entreprises ne possèdent pas. La qualité des données d'entraînement conditionne directement les performances du modèle. Et l'évaluation des résultats demande des métriques adaptées au cas d'usage.

La gouvernance pose également question. Qui est responsable des décisions prises par un SLM ? Comment auditer son fonctionnement ? Quelles garanties apporter aux utilisateurs finaux ? Autant de questions que les organisations doivent traiter avant tout déploiement en production.

Malgré ces défis, la tendance est claire : l'IA d'entreprise se rapproche des métiers, devient plus accessible et plus contrôlable. Les SLM en sont le vecteur principal.