Le 27 janvier 2025 restera dans les annales de la finance mondiale. En une seule séance, Nvidia a perdu près de 600 milliards de dollars de capitalisation boursière, soit la plus grande destruction de valeur de l'histoire pour une entreprise cotée. La cause ? Un modèle d'intelligence artificielle chinois nommé DeepSeek-R1. Selon la BBC, le capital-risqueur Marc Andreessen a qualifié cet événement de « moment Sputnik de l'IA ».

DeepSeek : l'outsider chinois qui défie OpenAI

DeepSeek est une startup chinoise fondée en 2023, relativement méconnue jusqu'à la sortie de son modèle R1 en janvier 2025. Contrairement aux géants comme Baidu ou Alibaba, elle n'est pas adossée à un conglomérat technologique. Son fondateur, Liang Wenfeng, est un ancien trader quantitatif reconverti dans l'IA.

Le modèle DeepSeek-V2, sorti en mai 2024, avait déjà attiré l'attention des spécialistes par ses performances sur les benchmarks. Mais c'est la version R1, publiée le 20 janvier 2025, qui a déclenché le séisme.

27 janvier 2025 : les chiffres du séisme

- -600 milliards de dollars : perte de capitalisation Nvidia en une séance (record historique)

- 6 millions de dollars : coût d'entraînement revendiqué pour DeepSeek-R1

- 100+ millions de dollars : coût estimé pour GPT-4

- 17x : ratio d'efficience entre les deux modèles

Des performances comparables à GPT-4... pour une fraction du coût

DeepSeek affirme que R1 égale, voire dépasse, les performances de GPT-4 sur des tâches de mathématiques, de codage et de raisonnement en langage naturel. Les benchmarks indépendants semblent confirmer ces affirmations, du moins sur certains tests.

Mais c'est le coût d'entraînement qui a stupéfié l'industrie. Alors qu'OpenAI aurait dépensé plus de 100 millions de dollars pour entraîner GPT-4, DeepSeek revendique un coût inférieur à 6 millions de dollars pour R1. Un ratio de 1 à 17 qui remet en question le modèle économique de l'IA générative.

Pourquoi Nvidia a-t-elle tant chuté ?

La réaction des marchés peut sembler disproportionnée. Nvidia ne fabrique pas de modèles d'IA, elle vend les puces qui permettent de les entraîner. Pourquoi la performance d'un modèle chinois affecterait-elle son cours de bourse ?

La réponse tient en un mot : efficience. Si DeepSeek a réussi à entraîner un modèle comparable à GPT-4 avec 17 fois moins de ressources, cela suggère que la demande future en puces Nvidia pourrait être bien inférieure aux projections.

Le narratif qui portait l'action Nvidia reposait sur une hypothèse : l'entraînement de modèles d'IA toujours plus grands nécessiterait des quantités toujours plus importantes de GPU. DeepSeek a démontré qu'une autre voie était possible : des modèles plus efficients, entraînés avec moins de ressources.

Pour les entreprises qui s'interrogent sur leurs investissements en infrastructure IA, des prestations de conseil en intelligence artificielle permettent d'évaluer les options les plus adaptées à leurs besoins.

Les innovations techniques de DeepSeek

Comment DeepSeek a-t-il atteint ces performances avec des moyens limités ? Plusieurs innovations techniques sont citées :

Mixture of Experts (MoE). L'architecture MoE permet d'activer seulement une fraction des paramètres du modèle pour chaque requête. Un modèle de 600 milliards de paramètres peut ainsi fonctionner comme s'il n'en avait que 50 milliards, réduisant drastiquement les besoins en calcul.

Quantization agressive. DeepSeek utilise des techniques de quantization qui réduisent la précision des calculs (de 16 bits à 8 ou 4 bits) sans dégrader significativement les performances. Moins de bits signifie moins de mémoire et moins de calculs.

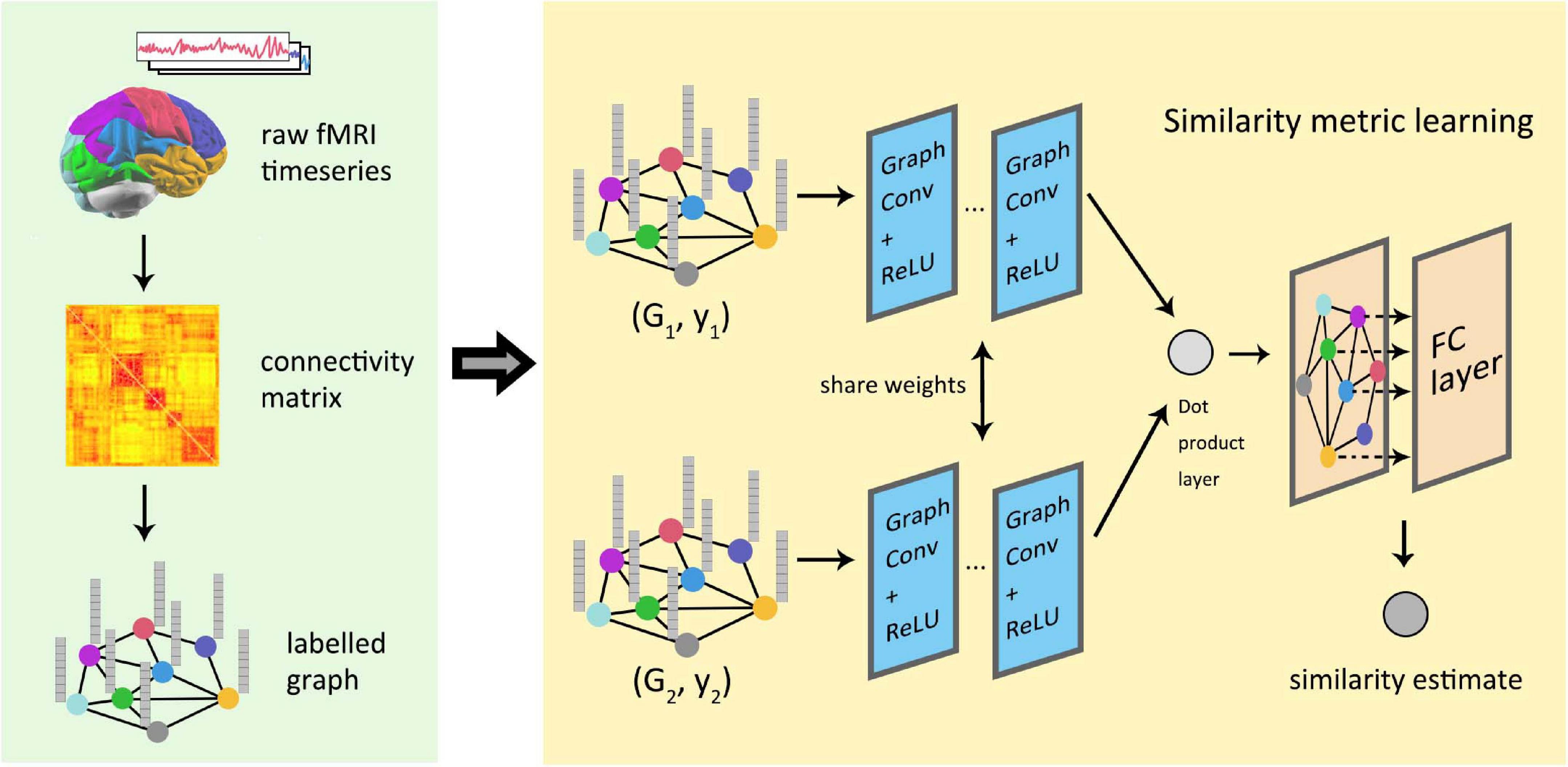

Distillation de connaissances. Le modèle R1 aurait été entraîné en partie par distillation, c'est-à-dire en apprenant à reproduire les comportements d'un modèle plus grand. Cette technique permet de transférer des capacités sans refaire tout l'entraînement.

Optimisation pour le matériel disponible. Soumise aux restrictions américaines sur les exportations de puces avancées, DeepSeek a dû optimiser son code pour fonctionner sur des GPU moins performants. Cette contrainte s'est transformée en avantage : un modèle qui tourne sur du matériel modeste est plus accessible et moins coûteux à déployer.

Open source : le choix stratégique de DeepSeek

Contrairement à OpenAI, qui garde ses modèles propriétaires, DeepSeek a choisi de publier R1 en open source. N'importe qui peut télécharger le modèle, l'étudier, le modifier et le déployer.

Ce choix n'est pas altruiste. En rendant son modèle accessible, DeepSeek gagne en visibilité et en crédibilité, attire des talents qui veulent travailler sur des projets ouverts, bénéficie des contributions de la communauté pour améliorer le modèle, et affaiblit les concurrents propriétaires en commoditisant la technologie.

Marc Andreessen a qualifié R1 de « cadeau profond au monde ». Une formulation qui traduit l'impact potentiel de cette ouverture sur l'écosystème mondial de l'IA.

Implications pour les entreprises françaises

L'épisode DeepSeek porte plusieurs enseignements pour les organisations qui déploient ou envisagent de déployer des solutions d'IA :

Les modèles open source deviennent compétitifs. Il n'est plus nécessaire de payer des fortunes en API pour accéder à des capacités de pointe. Des modèles comme DeepSeek-R1, Mistral ou Llama offrent des alternatives crédibles aux solutions propriétaires.

L'efficience compte autant que la puissance brute. Un modèle plus petit mais mieux optimisé peut surpasser un géant mal conçu. Les entreprises gagneront à évaluer le rapport performance/coût plutôt que de se focaliser sur le nombre de paramètres.

La dépendance aux fournisseurs américains n'est pas une fatalité. DeepSeek démontre que des acteurs non-américains peuvent rivaliser avec les leaders. La diversification des sources technologiques devient une option réaliste.

Comme nous l'avons analysé dans notre dossier sur les Small Language Models, la tendance est à des modèles plus ciblés, plus efficients et plus accessibles. DeepSeek s'inscrit pleinement dans cette dynamique.

Questions en suspens

L'épisode DeepSeek soulève aussi des interrogations :

Les chiffres sont-ils fiables ? DeepSeek n'a pas publié de détails complets sur sa méthodologie d'entraînement. Certains analystes suspectent que les coûts annoncés excluent des dépenses significatives (recherche préalable, infrastructure, salaires).

Quelle pérennité ? Une startup sans adossement à un grand groupe peut-elle maintenir le rythme d'innovation face à OpenAI, Google ou Anthropic ? Les ressources financières et humaines restent asymétriques.

Quelles implications géopolitiques ? La démonstration de capacités chinoises en IA pourrait renforcer les restrictions américaines sur les exportations de technologies. Un cercle vicieux qui accélérerait la fragmentation de l'écosystème mondial.

Un tournant dans l'histoire de l'IA

Que DeepSeek tienne ou non ses promesses sur le long terme, le 27 janvier 2025 marque un tournant. Il a démontré que la course à l'IA ne se gagnait pas uniquement à coups de milliards de dollars et de millions de GPU.

L'ingéniosité, l'efficience et l'ouverture peuvent constituer des avantages compétitifs. Une leçon que les acteurs européens, souvent contraints par des budgets limités, feraient bien de méditer.

Le moment Sputnik de l'IA a sonné. Reste à savoir qui saura en tirer les conséquences.